สปอตไลท์: เอไอแชท, เกมเช่นย้อนยุค, ตัวเปลี่ยนตำแหน่ง, Roblox เลิกบล็อกแล้ว

สปอตไลท์: เอไอแชท, เกมเช่นย้อนยุค, ตัวเปลี่ยนตำแหน่ง, Roblox เลิกบล็อกแล้ว

นับตั้งแต่การเปิดตัว Llama 1 อันเป็นก้าวสำคัญ API แบบปิดที่เป็นกรรมสิทธิ์ก็ถูกทำให้เป็นประชาธิปไตยอย่างถาวร ซีรีส์ Llama (Large Language Model Meta AI) แบบโอเพนซอร์สของ Meta ได้พลิกโฉมภูมิทัศน์ AI Llama 3 ประสิทธิภาพสูงและ Llama 4 รุ่นล่าสุด ทำให้โมเดลตระกูลนี้เป็นรากฐานสำหรับนวัตกรรม AI แบบโอเพนซอร์ส

หากคุณสับสนกับโมเดล AI มากมาย โปรดอ่านข้อมูลที่ครอบคลุมนี้ รีวิวลามะคุณสามารถเรียนรู้ว่า Llama คืออะไร อะไรที่ทำให้ Llama AI โดดเด่น เหตุผลทางธุรกิจที่น่าสนใจ ตำแหน่งในการแข่งขันกับยักษ์ใหญ่เช่น ChatGPT คู่มือปฏิบัติสำหรับองค์กร และอื่นๆ อีกมากมาย

สารบัญ

ลามะ หมายถึงชุดแบบจำลองภาษาขนาดใหญ่พื้นฐานที่พัฒนาโดย Meta ซึ่งแตกต่างจากแบบจำลองก่อนหน้าที่สามารถเข้าถึงได้ผ่าน API เท่านั้น ชุด Llama นี้เผยแพร่สู่สาธารณะเพื่อการวิจัยและการใช้งานเชิงพาณิชย์ อันที่จริงแล้ว ใบอนุญาตแบบกำหนดเองได้รับการออกแบบมาเพื่อป้องกันการใช้งานในทางที่ผิด และจะมีผลบังคับใช้ภายใต้เงื่อนไขการปรับขนาดที่เฉพาะเจาะจง เวอร์ชันล่าสุดคือ Llama 4

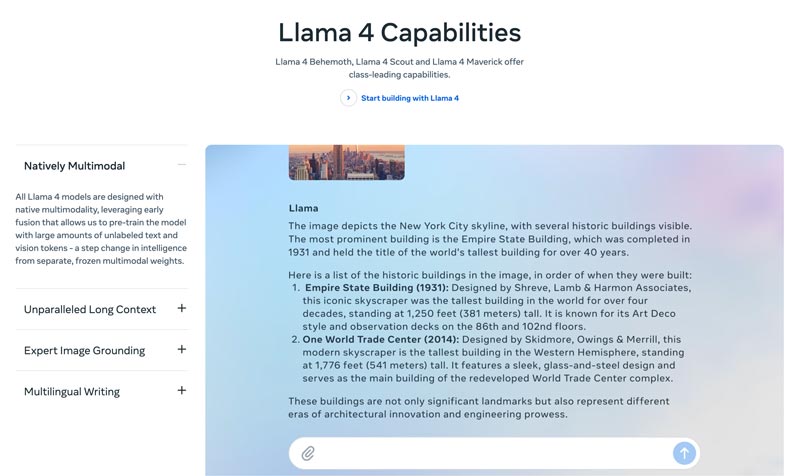

ลามะ 4 เป็นเวอร์ชันล่าสุด Meta อ้างว่าเป็นเวอร์ชันที่ชาญฉลาด ปรับขนาดได้ และสะดวกสบายที่สุด ด้วยความสามารถในการใช้เหตุผลและการวางแผนขั้นสูง ความสามารถแบบมัลติโมดัล และฟังก์ชันการเขียนหลายภาษา Llama 4 จึงสามารถเป็นหน้าต่างบริบทชั้นนำของอุตสาหกรรม ช่วยให้คุณนำไอเดียสุดล้ำของคุณไปปรับใช้ได้อย่างง่ายดายด้วย Llama API และ Llama Stack ปัจจุบัน Llama 4 มอบประสบการณ์ที่เป็นส่วนตัวมากขึ้น

ลามะ 3 เปิดตัวในเดือนเมษายน พ.ศ. 2567 เมื่อเปรียบเทียบกับ Llama 2 แล้ว Llama 3 มีการปรับปรุงหลายประการ รวมถึงการใช้เหตุผลและการเข้ารหัสที่ได้รับการปรับปรุง ข้อมูลการฝึกอบรมที่ได้รับการปรับปรุง หน้าต่างบริบทที่ใหญ่ขึ้น และตัวสร้างโทเค็นที่มีประสิทธิภาพมากขึ้น

ลามะ 1 และ 2: Llama เวอร์ชันดั้งเดิมเปิดตัวในต้นปี 2023 และ Llama 2 เปิดตัวในเดือนกรกฎาคม 2023 นับเป็นการเข้าสู่วงการแชทบอทโดยตรงของ Meta ด้วยเวอร์ชันที่ปรับแต่งมาอย่างดี นับตั้งแต่ Llama 2 ซีรีส์นี้จึงมอบบทสนทนาที่เป็นประโยชน์และปลอดภัย Llama 1/2 ได้รับการพัฒนาขึ้นเพื่อแข่งขันกับ ChatGPT ของ OpenAI และ Bard ของ Google เป็นหลัก

พัฒนาโดย Meta เพื่อปรับเปลี่ยนภูมิทัศน์ของ AI ประสิทธิภาพสูง ไม่ต้องกังวล Llama ได้รับการปรับแต่งให้เหมาะสมกับข้อมูลเฉพาะของบริษัทคุณ เพื่อให้มีประสิทธิภาพเหนือกว่าโมเดลทั่วไปขนาดใหญ่สำหรับงานเฉพาะด้าน ศักยภาพในการปรับแต่งทำให้เหมาะสำหรับนักพัฒนาและนักวิจัยส่วนใหญ่

ความพิเศษของลามะไม่ได้อยู่ที่ประสิทธิภาพเพียงอย่างเดียว ระบบนิเวศที่ลามะได้เกิดขึ้น อาจเป็นข้อได้เปรียบที่ยิ่งใหญ่กว่า ระบบนิเวศ Hugging Face ของ Hugging Face ได้จุดประกายให้เกิดนวัตกรรมใหม่ๆ มากมาย มีผลิตภัณฑ์ดัดแปลงที่ปรับแต่งแล้วหลายพันรายการสำหรับงานต่างๆ ที่เป็นไปได้

นอกจากนี้ Llama ยังได้มอบ LLM ระดับชั้นนำไว้ในมือของทุกคน การทำให้ AI เป็นประชาธิปไตย เป็นอีกหนึ่งข้อดีที่ทำให้ Llama โดดเด่นไม่เหมือนใคร โมเดล AI ของ Llama พร้อมให้นักวิจัย นักพัฒนา และสตาร์ทอัพทุกคนใช้งาน สร้างสรรค์ และสร้างนวัตกรรมได้โดยไม่ต้องเสียค่าธรรมเนียม API หรือขออนุญาต

ข้อได้เปรียบเชิงกลยุทธ์สำหรับธุรกิจ Llama ให้คุณเป็นเจ้าของอาคาร AI ของคุณเอง คุณไม่จำเป็นต้องผูกติดกับราคาของผู้ขาย การเปลี่ยนแปลงนโยบาย หรือการเลิกใช้ API อีกต่อไป ซึ่งจะช่วยหลีกเลี่ยงการผูกขาดกับผู้ขายได้อย่างมีประสิทธิภาพ

เหตุผลทางธุรกิจของ Llama ไม่ใช่แค่การใช้โมเดล AI ที่แตกต่างออกไปเท่านั้น แต่ในความเป็นจริงแล้ว มันอาจเป็นการเปลี่ยนแปลงพื้นฐานในวิธีที่บริษัทดำเนินการกับ AI ก็ได้

ในช่วงแรก ธุรกิจจำนวนมากได้นำบริการที่ใช้ API มาใช้ เช่น GPT-4 ของ OpenAI ซึ่งเป็นตัวเลือกที่สะดวกที่สุด ช่วยให้สามารถทดลองและสร้างต้นแบบได้อย่างรวดเร็วและมีอุปสรรคน้อย อย่างไรก็ตาม กลยุทธ์ AI นี้ถูกแทนที่ด้วยแนวทางเชิงกลยุทธ์ระยะยาวมากขึ้น ซึ่งเป็นโมเดลพื้นฐานแบบโอเพนซอร์ส เช่น Llama ของ Meta กรณีของ Llama ตั้งอยู่บนปัจจัยสำคัญสามประการ ได้แก่ การประหยัดต้นทุน การควบคุมและการปรับแต่ง และความปลอดภัยของข้อมูล.

ค่าใช้จ่าย API สำหรับหลายบริษัท (ที่ประมวลผลคิวรีหลายล้านรายการต่อวัน) อาจสูงถึงหลายล้านบาทต่อปี การนำ Llama มาใช้ถือเป็นการเปลี่ยนจากค่าใช้จ่ายในการดำเนินงาน (OpEx) ไปเป็นค่าใช้จ่ายด้านการลงทุน (CapEx) ซึ่งทำให้ ROI ชัดเจนขึ้นเมื่อใช้งานในปริมาณมาก

Llama ช่วยให้คุณสร้าง AI ที่ได้รับการปรับแต่งอย่างพิถีพิถันและเป็นเอกลักษณ์เฉพาะตัว ซึ่งเหมาะสมกับธุรกิจหรือผลิตภัณฑ์ของคุณมากที่สุด คุณยังสามารถควบคุมอินพุตและเอาต์พุตของโมเดลได้อย่างสมบูรณ์ AI จะกลายเป็นสินทรัพย์หลัก ไม่ใช่บริการเช่า

ภาครัฐและภาคการเงินมีข้อกำหนดการกำกับดูแลข้อมูลที่เข้มงวด Llama สามารถติดตั้งใช้งานแบบ on-premise หรือใน VPC (Virtual Private Cloud) ที่ได้มาตรฐาน ซึ่งมักเป็นวิธีเดียวที่ถูกกฎหมายในการใช้ประโยชน์จากเทคโนโลยี LLM ยิ่งไปกว่านั้น การติดตั้ง Llama ภายใน VPC ที่ปลอดภัยยังช่วยให้ข้อมูลทั้งหมดของคุณได้รับความปลอดภัยและไม่ถูกส่งออกนอกไฟร์วอลล์ของคุณ ซึ่งจะช่วยลดความเสี่ยงจากการเปิดเผยข้อมูลของบุคคลที่สามได้อย่างมีประสิทธิภาพ

กล่าวโดยสรุป กรณีทางธุรกิจของ Llama คือ การเป็นเจ้าของคุณจะได้รับคืนความเป็นเจ้าของข้อได้เปรียบในการแข่งขัน ความปลอดภัยของข้อมูล และต้นทุนของคุณ

Llama ของ Meta นำเสนอวิธีใหม่สำหรับธุรกิจในการใช้ AI โมเดล AI อันทรงพลังนี้มีแอปพลิเคชันที่หลากหลาย รวมถึง AI เชิงสนทนา รูปภาพ และ การสร้างข้อความการฝึกอบรมภาษา การสรุป และงานอื่นๆ ที่เกี่ยวข้อง ด้วยการใช้ความสามารถขั้นสูงของ AI Llama สามารถช่วยให้ธุรกิจต่างๆ ประสบความสำเร็จได้

• ฝ่ายบริการลูกค้าและการสนับสนุน

แชทบอทขั้นสูงหรือผู้ช่วยเสมือนที่ขับเคลื่อนโดย Llama สามารถเข้าใจคำถามของลูกค้าได้ดีขึ้น โดยเฉพาะคำถามที่ซับซ้อน และให้คำตอบที่ถูกต้องและเข้าใจบริบท การให้การสนับสนุนลูกค้าตลอด 24 ชั่วโมงทุกวันจึงเป็นประโยชน์อย่างยิ่ง

• การวิเคราะห์ข้อมูลและปัญญาทางธุรกิจ

Llama สามารถดึงข้อมูลจากหลากหลายแหล่ง และตัดสินใจในเบื้องต้นที่จำเป็นต้องมีทักษะทางเทคนิค ช่วยให้ผู้จัดการธุรกิจและนักวิเคราะห์สามารถค้นหาข้อมูล SQL ได้โดยการถามคำถาม โมเดลนี้สามารถวิเคราะห์ข้อความ รูปภาพ แผนภูมิ และเนื้อหาอื่นๆ เพื่อสรุปข้อมูลเชิงบรรยาย ซึ่งช่วยให้ระบุแนวโน้มใหม่ๆ ข้อมูลเชิงลึกของคู่แข่ง และข้อร้องเรียนที่พบบ่อยได้อย่างรวดเร็ว

• การตลาดและเนื้อหาอัตโนมัติ

กระบวนการสร้างเนื้อหาคุณภาพสูงและปรับแต่ง SEO นั้นใช้เวลานาน Llama สามารถสร้างฉบับร่างหรือบทความทั้งบทความได้อย่างรวดเร็วด้วยหัวข้อง่ายๆ และคีย์เวิร์ดหลายคำ จากนั้นบรรณาธิการที่เป็นมนุษย์ก็สามารถปรับแต่งผลลัพธ์เหล่านี้ได้ โมเดลนี้ยังสามารถสร้างโพสต์บนโซเชียลมีเดียได้โดยอัตโนมัติ ยิ่งไปกว่านั้น ยังช่วยเขียนหัวข้ออีเมลและโฆษณาที่น่าสนใจได้อีกด้วย

• การพัฒนาซอฟต์แวร์

โมเดล Llama เฉพาะโค้ดสามารถทำหน้าที่เป็นระบบเติมข้อความอัตโนมัติขั้นสูงเพื่อรักษาคุณภาพของโค้ด จัดการระบบเดิม และเร่งวงจรการพัฒนา สามารถช่วยตรวจสอบโค้ดเพื่อหาจุดบกพร่องที่อาจเกิดขึ้นได้ นอกจากนี้ ยังสามารถสร้างและอัปเดตเอกสารประกอบโค้ดและเอกสารอ้างอิง API โดยอัตโนมัติตามความคิดเห็นของโค้ดต้นฉบับได้อีกด้วย

ส่วนนี้แสดงการเปรียบเทียบแบบเคียงข้างกันระหว่างซีรีส์ Llama ของ Meta กับตัวเลือกชั้นนำอื่นๆ ในรูปแบบตาราง คุณสามารถเปรียบเทียบปัจจัยสำคัญเหล่านี้เพื่อค้นหาตัวเลือกที่เหมาะสมที่สุดกับความต้องการเฉพาะของคุณ

ควรชัดเจนว่าโมเดล AI เหล่านี้มีจุดแข็งและจุดอ่อนของตัวเอง การเลือกไม่ใช่การหาทางเลือกเดียว

| แบบจำลอง AI | เมต้าส์ LLaMA 4/3/2 | GPT-4 ของ OpenAI | คล็อด 3 ของแอนโทรปิก | PaLM 2 ของ Google |

| ใบอนุญาต | โอเพ่นซอร์ส ใบอนุญาตแบบกำหนดเอง | กรรมสิทธิ์ | กรรมสิทธิ์ | กรรมสิทธิ์ |

| เข้าถึง | ดาวน์โหลดและโฮสต์ด้วยตนเอง | เฉพาะ API เข้าถึงผ่านการสมัครสมาชิก | เฉพาะ API การเข้าถึงผ่านการกำหนดราคาตามการใช้งาน | เฉพาะ API เข้าถึงได้ผ่าน Vertex AI ของ Google |

| แบบจำลอง AI | เมต้าส์ LLaMA 4/3/2 | GPT-4 ของ OpenAI | คล็อด 3 ของแอนโทรปิก | PaLM 2 ของ Google |

| ประสิทธิภาพ | ระดับสูงสุด แข่งขันกับโมเดล AI ชั้นนำได้ ต้องมีการปรับแต่งอย่างละเอียดเพื่อให้ตรงกับประสิทธิภาพของ GPT-4 ในงานเฉพาะ ขาดความสามารถในการส่งมอบเนื้อหาสร้างสรรค์คุณภาพสูงที่น่าดึงดูด | ผู้นำในอุตสาหกรรม จัดการกับการใช้เหตุผลที่ซับซ้อน ความละเอียดอ่อน และการแก้ปัญหาอย่างสร้างสรรค์ | ระดับสูงสุด ยอดเยี่ยมในการวิเคราะห์ข้อมูล การสนทนาที่ซับซ้อน และการใช้เหตุผลในบริบทยาว | ระดับสูงสุด เก่งด้านการใช้เหตุผลและงานหลายภาษา |

| โครงสร้างต้นทุน | CapEx สูง, OpEx ต่ำ ต้นทุนจะปรับขนาดตามขนาดโมเดลและปริมาณการใช้งาน | ไม่มี CapEx, OpEx สูง ต้นทุนเริ่มต้น แต่จ่ายตามการใช้งาน | ไม่มี CapEx, OpEx สูง คล้ายกับ OpenAI จ่ายตามโทเค็น | ไม่มี CapEx, OpEx สูง จ่ายต่อโทเค็นบน Vertex AI พร้อมส่วนลดตามปริมาณ |

| ความเป็นส่วนตัวและความปลอดภัยของข้อมูล | การควบคุมสูงสุด ข้อมูลจะไม่มีวันออกจากโครงสร้างพื้นฐานของคุณ เหมาะสำหรับอุตสาหกรรมที่มีการควบคุมอย่างเข้มงวด | ข้อมูลอินพุต/เอาต์พุตได้รับการประมวลผลบนเซิร์ฟเวอร์ของ OpenAI | นโยบายความเป็นส่วนตัวที่เข้มงวด แต่ข้อมูลได้รับการประมวลผลโดย Anthropic | ความปลอดภัยระดับองค์กร ข้อมูลที่ประมวลผลบน Google Cloud นำเสนอการควบคุม VPC และความมุ่งมั่นในการจัดเก็บข้อมูล |

| การปรับแต่งและการควบคุม | การควบคุมแบบสมบูรณ์ สามารถปรับแต่งได้เต็มที่บนข้อมูลที่เป็นกรรมสิทธิ์ | ถูก จำกัด การปรับแต่งละเอียดมีเฉพาะรุ่นเก่าเท่านั้น (ไม่ใช่ GPT-4) | ถูก จำกัด ปรับแต่งผ่านวิศวกรรมและบริบทที่รวดเร็ว | แข็งแกร่ง การสนับสนุนที่ดีสำหรับการปรับแต่งและการเรียนรู้การเสริมแรง |

| ความสามารถในการปรับขนาด | คุณต้องจัดเตรียมและจัดการโครงสร้างพื้นฐานของคุณเอง | OpenAI จัดการโครงสร้างพื้นฐานทั้งหมด | Anthropic จัดการโครงสร้างพื้นฐานทั้งหมด | Google Cloud จัดการโครงสร้างพื้นฐาน |

โดยทั่วไปแล้ว Llama เหมาะอย่างยิ่งสำหรับบริษัทที่ต้องการการควบคุมที่สมบูรณ์แบบ ความเป็นส่วนตัวของข้อมูล และความสามารถในการปรับแต่ง GPT-4 เหมาะที่สุดสำหรับองค์กรที่ต้องการประสิทธิภาพและความสามารถในการใช้เหตุผลขั้นสูง สามารถจัดการงานที่ซับซ้อนได้ดีขึ้น โดยเฉพาะอย่างยิ่งการวิเคราะห์เชิงสร้างสรรค์และขั้นสูง Claude 3 เหมาะอย่างยิ่งสำหรับการใช้งานที่ให้ความสำคัญกับความปลอดภัยและการลดอคติ แทบไม่ก่อให้เกิดผลลัพธ์ที่เป็นอันตราย PaLM 2 เหมาะที่สุดสำหรับธุรกิจที่ผสานรวมเข้ากับระบบนิเวศ Google Cloud อย่างลึกซึ้ง ช่วยให้มั่นใจได้ว่าสามารถผสานรวมกับเครื่องมืออื่นๆ ของ Google ได้อย่างราบรื่น

ก่อนใช้งาน Llama คุณควรพิจารณาความต้องการของคุณให้สอดคล้องกับกรณีการใช้งานจริงก่อน ไม่ว่าคุณจะต้องการโมเดลพารามิเตอร์ 70B เพื่อคุณภาพสูงสุด หรือต้องการแค่โมเดล 8B สำหรับงานพื้นฐาน

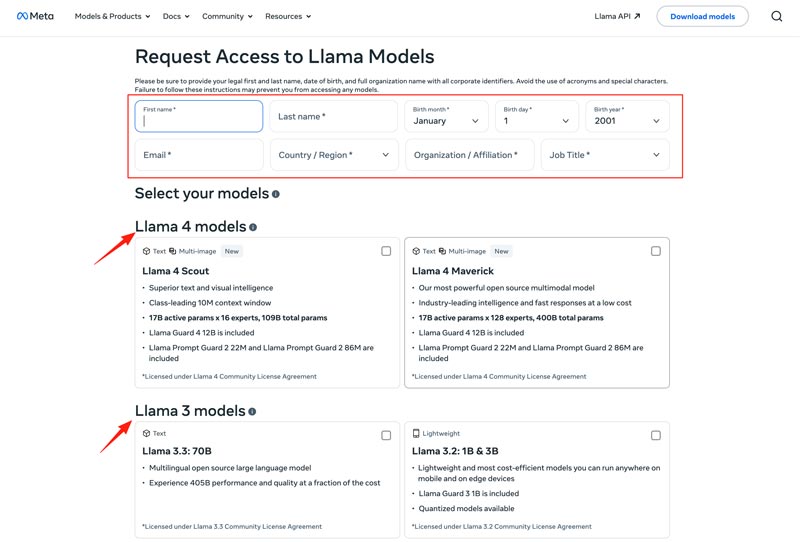

คุณควรเลือกวิธีการปรับใช้ของคุณ เช่น เครื่องภายใน, VM บนคลาวด์ หรือบริการที่มีการจัดการ การรันโมเดล Llama อย่างมีประสิทธิภาพมักต้องใช้ GPU ที่ทรงพลัง โดยเฉพาะอย่างยิ่งสำหรับโมเดลขนาดใหญ่ หลังจากนั้น คุณสามารถดาวน์โหลดโมเดลที่ถูกต้องได้จากเว็บไซต์ Meta

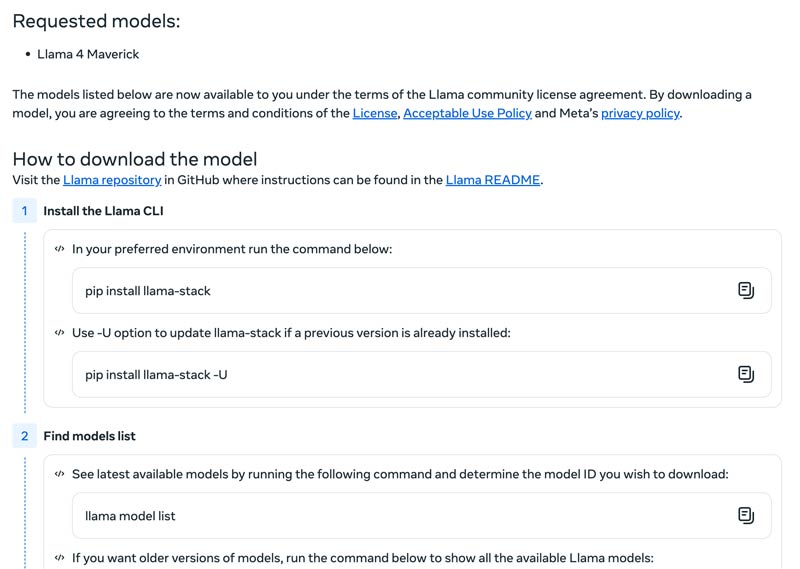

คลิก ดาวน์โหลดโมเดล ปุ่มเพื่อเข้าสู่ ขอการเข้าถึง หน้า ระบุข้อมูลที่ต้องการและเลือกโมเดลลามะที่ต้องการ

คลิก ถัดไป ปุ่มอ่าน ข้อกำหนดและเงื่อนไขคุณควรตรวจสอบข้อตกลงอนุญาตสิทธิ์ชุมชนอย่างละเอียดแล้วคลิก ยอมรับและดำเนินการต่อ ปุ่ม ทำตามคำแนะนำบนหน้าจอเพื่อดาวน์โหลดรุ่นที่คุณเลือก

คุณสามารถใช้เฟรมเวิร์กอย่าง Text Generation Inference เพื่อรับเซิร์ฟเวอร์ API ประสิทธิภาพสูง หากคุณต้องการอินเทอร์เฟซแชท ให้ปรับใช้ UI เช่น แชทบอท UI หรือ NextChat จากนั้นใช้ข้อมูลที่เป็นกรรมสิทธิ์ของคุณร่วมกับเฟรมเวิร์กเพื่อสร้างโมเดลเฉพาะของคุณเอง

คุณควรทราบวิธีการเอาชนะความท้าทายเพื่อใช้โมเดล AI ได้อย่างมีประสิทธิภาพ

• ความซับซ้อนในการตั้งค่าเริ่มต้น

คุณสามารถใช้เครื่องมือและคอนเทนเนอร์ที่สร้างไว้ล่วงหน้าได้ รันโมเดลในเครื่องได้ด้วยคำสั่งเดียว คุณยังสามารถเปลี่ยนไปใช้แพลตฟอร์มบนคลาวด์ได้โดยไม่ต้องตั้งค่าใดๆ Hugging Face ช่วยให้คุณรันและสร้างเดโมโดยใช้สภาพแวดล้อมที่กำหนดค่าไว้ล่วงหน้า นอกจากนี้ คุณยังสามารถเริ่มต้นด้วย llama.cpp เพื่อรัน Llama เวอร์ชันควอนไทซ์ได้

• การจัดการทรัพยากรและการเพิ่มประสิทธิภาพต้นทุน

โมเดลขนาดใหญ่ต้องใช้ GPU ที่มีหน่วยความจำสูง ซึ่งมักจะหายากและมีราคาแพง

การหาปริมาณเป็นเทคนิคที่มีประสิทธิภาพสูงสุด คุณสามารถใช้ไลบรารีสำหรับการหาปริมาณ 4 บิตในระหว่างการอนุมานหรือการปรับแต่งละเอียด สำหรับฮาร์ดแวร์ที่มีประสิทธิภาพน้อยกว่า ให้ใช้ llama.cpp เพื่อรันโมเดล ทั้งสองวิธีนี้สามารถลดการใช้หน่วยความจำได้อย่างมีประสิทธิภาพ นอกจากนี้ ตรวจสอบให้แน่ใจว่าคุณเลือกโมเดลที่ถูกต้องสำหรับงานของคุณ โมเดลขนาดเล็กที่ปรับแต่งละเอียดแล้วอาจคุ้มค่ากว่า

• คอยติดตามข่าวสารล่าสุด

มีการเปิดตัวโมเดล เทคนิค และไลบรารีใหม่ๆ มากมายทุกสัปดาห์ การติดตามให้ทันสมัยอยู่เสมออาจเป็นเรื่องยาก

คุณควรสมัครรับข้อมูลบล็อกอย่างเป็นทางการ เช่น Meta AI, Hugging Face และ vLLM ยิ่งไปกว่านั้น ยังมีการแบ่งปันเทคนิคการปรับแต่ง แอปพลิเคชัน การเพิ่มประสิทธิภาพ ประสบการณ์ โซลูชัน และอื่นๆ อีกมากมายบนแพลตฟอร์มอย่าง GitHub และ Hugging Face ซึ่งช่วยให้ทีมของคุณผสานรวมการปรับปรุงต่างๆ เข้าด้วยกันได้

คุณอาจต้องการ:

คำถาม 1. อนุญาตให้ใช้ผลลัพธ์ของโมเดล Llama เพื่อฝึกอบรม LLM อื่นๆ หรือไม่

ใช่ Meta อนุญาตให้ใช้ผลลัพธ์ของ Llama เวอร์ชันใหม่กว่า (Llama 3.1 ขึ้นไป) เพื่อฝึกอบรมโมเดลอื่นๆ แน่นอนว่าคุณไม่ได้รับอนุญาตให้ใช้ผลลัพธ์นี้เพื่อสร้างผลิตภัณฑ์ที่แข่งขันกับ Meta นอกจากนี้ คุณต้องตระหนักถึงขอบเขตทางกฎหมายที่กำหนดไว้ในใบอนุญาตของ Meta อย่างเคร่งครัด

คำถามที่ 2. โมเดลลามะมีข้อจำกัดหรือไม่? มีข้อกำหนดที่เกี่ยวข้องอะไรบ้าง?

ใช่ โมเดล Llama มีข้อจำกัดสำคัญ ซึ่งกำหนดโดยโครงสร้างการอนุญาตสิทธิ์ โมเดลเหล่านี้ไม่ใช่โอเพนซอร์สอย่างแท้จริง แต่เผยแพร่ภายใต้ใบอนุญาตที่เป็นกรรมสิทธิ์ของ Meta เพื่อปกป้องผลประโยชน์ของ Meta และป้องกันกรณีการใช้งานที่เป็นการแข่งขัน

คำถามที่ 3. กรณีการใช้งานทั่วไปของ Llama มีอะไรบ้าง?

กรณีการใช้งาน Llama ในชีวิตประจำวันประกอบด้วยการทำความเข้าใจภาพและเอกสาร การตอบคำถาม การสร้างภาพและข้อความ การสร้างและสรุปภาษา การฝึกภาษา ปัญญาประดิษฐ์สำหรับการสนทนา และอื่นๆ อีกมากมาย Llama สามารถตอบคำถามของคุณโดยอิงจากเนื้อหาภาพหรือเอกสารที่คุณให้มา นอกจากนี้ ยังสามารถใช้สร้างแชทบอทหรือผู้ช่วยด้านภาพได้อีกด้วย

คำถามที่ 4. ข้อกำหนดฮาร์ดแวร์สำหรับการใช้โมเดล Llama มีอะไรบ้าง

ข้อกำหนดด้านฮาร์ดแวร์สำหรับการรันโมเดล Llama นั้นพิจารณาจากปัจจัยหลักสามประการ ได้แก่ ขนาดของโมเดล การวัดปริมาณ และกรณีการใช้งาน สำหรับนักพัฒนาส่วนใหญ่ RTX 4070/4080/4090 หรือ Mac ที่มีหน่วยความจำแบบ Unified ขนาด 16-36GB ถือเป็นตัวเลือกที่ยืดหยุ่นสำหรับโมเดล Llama ที่มีความจุสูงสุดถึง 70GB สำหรับการใช้งานบน GPU ปัจจัยที่สำคัญที่สุดคือ VRAM ของการ์ดจอของคุณ ดังที่ได้กล่าวไปแล้ว ให้เลือกขนาดของโมเดลที่ถูกต้องตามความต้องการของคุณ จากนั้นเลือกระดับการวัดปริมาณที่สามารถรันบนฮาร์ดแวร์ของคุณได้

คำถามที่ 5. Llama ดีเท่ากับ ChatGPT หรือไม่?

คุณสามารถตรวจสอบตารางด้านบนเพื่อเปรียบเทียบปัจจัยสำคัญระหว่างลามะและ ChatGPTLlama สามารถรันได้ทั้งแบบโลคัลและออฟไลน์ มอบการปกป้องข้อมูลที่ปลอดภัยยิ่งขึ้น นอกจากนี้ ตัวโมเดล Llama ยังใช้งานได้ฟรี ChatGPT มีเวอร์ชันฟรี แต่โมเดลและฟีเจอร์ขั้นสูงจำเป็นต้องใช้แพ็กเกจแบบชำระเงิน

บทสรุป

ลามะ ไม่ใช่แค่โมเดลอีกแบบหนึ่ง แต่มักถูกมองว่าเป็นการเปลี่ยนแปลงเชิงกลยุทธ์สู่อนาคต AI ที่เข้าถึงและปรับแต่งได้มากขึ้น คุณสามารถเรียนรู้ข้อมูลต่างๆ ที่เกี่ยวข้องกับตระกูล Llama AI ได้ในรีวิวที่ตรงไปตรงมานี้ แล้วลองดูว่าคุ้มค่ากับกระแสตอบรับหรือไม่

คุณพบว่าสิ่งนี้มีประโยชน์หรือไม่?

484 โหวต