Spotlight: AI-chat , spil som Retro , lokationsskifter , Roblox fjernet blokering

Spotlight: AI-chat , spil som Retro , lokationsskifter , Roblox fjernet blokering

Træt af uendelige AI-billedværktøjer?

Stable Diffusion positionerer sig som en “friheds”-løsning til AI-billedgenerering. Når du søger efter en kraftfuld tekst-til-billede-model, der kan generere billeder i høj kvalitet baseret på dine tekstbeskrivelser, kan du støde på den eller få relaterede anbefalinger.

Men i et hastigt voksende felt med lignende modeller og konkurrenter som Midjourney, Seedance og Veo 3, kan du undre dig: Er Stable Diffusion din tid værd, eller leverer Stable Diffusion virkelig professionelle resultater?

Denne anmeldelse af Stable Diffusion giver al nødvendig information om denne AI-billedgenereringsmodel og besvarer netop det spørgsmål.

Indholdsfortegnelse

Stable Diffusion er en fleksibel deep learning-tekst-til-billede-model udviklet af Stability AI. Den er baseret på diffusionsteknologi (udgivet i 2022), som kan omdanne tekstbeskrivelser til visuelle repræsentationer. Modellen anvender en CLIP ViT-L/14-tekstencoder til at generere billeder i høj kvalitet som svar på prompts.

Sammenlignet med tidligere diffusionsmodeller reducerer den nyeste Stable Diffusion 3.5 hukommelseskravene betydeligt. Den er designet med en stor arkitektonisk innovation ved at implementere diffusionsprocessen i et latent rum. Tidligere modeller opererer direkte i billedrummet.

Takket være det tekniske gennembrud og dets open source-natur har Stable Diffusion hurtigt tiltrukket en langt bredere brugerbase, herunder udviklere, forskere, individuelle skabere og virksomhedsbrugere.

• Konstant forbedring med versionsopdateringer. Siden den første udgivelse har denne tekst-til-billede-genereringsmodel gennemgået en betydelig udvikling. Hovedversionerne omfatter Stable Diffusion 1.5, 2.0, 2.1, 3.0 og den seneste 3.5-serie. De har foretaget væsentlige forbedringer på forskellige områder, herunder outputkvalitet, forståelse af prompts og genereringsevner med mere.

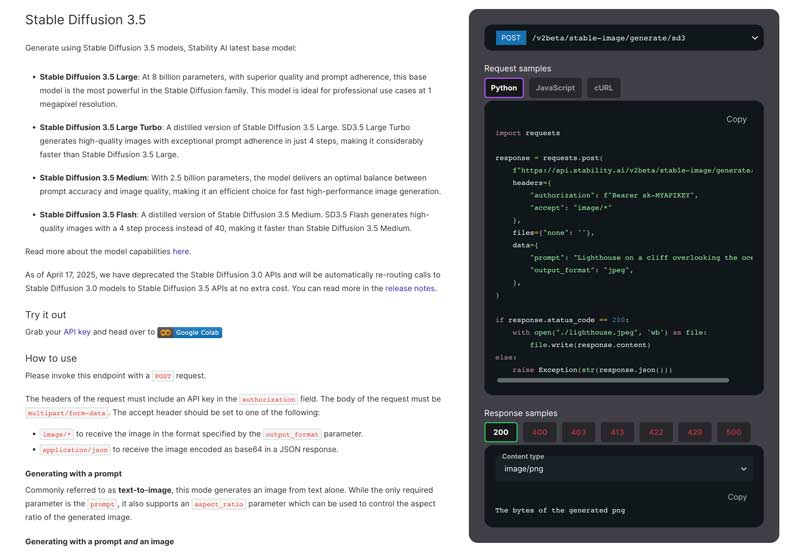

• Flere modelversioner. Flere specialiserede modeller er designet til at opfylde forskellige brugerbehov. Den nyeste basismodel er Stable Diffusion 3.5. Den giver markante forbedringer i forhold til tidligere versioner. Der er i øjeblikket fire hovedversioner i Stable Diffusion-familien: Stable Diffusion 3.5 Large, Large Turbo, Medium og Flash.

• Avanceret promptforståelse. Den nuværende Stable Diffusion 3.5 har en sofistikeret arkitektur med flere tekstencodere, som gør det muligt at behandle mere komplekse og detaljerede prompts mere effektivt. Den kan behandle tekstbeskrivelser på op til 10.000 tegn. Det gør det muligt for brugerne at give mere detaljerede beskrivelser. Samtidig kan Stable Diffusion producere resultater af højere kvalitet og med større nøjagtighed.

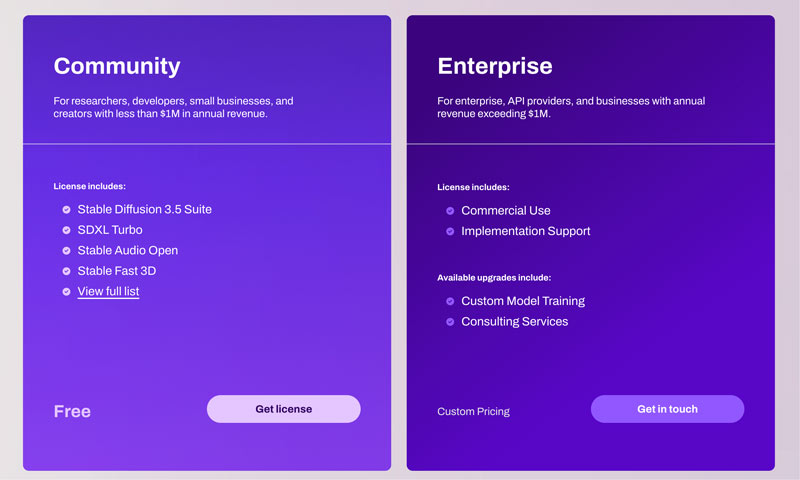

• Kommerciel og kreativ fleksibilitet. Stable Diffusion 3.5-modeller udgives under Stability AI Community License og Enterprise License. Det tillader både kommerciel og ikke-kommerciel brug. For de fleste almindelige brugere, såsom forskere, udviklere og små virksomheder med en årlig omsætning på under $1M, kan de bruge Stable Diffusion frit uden begrænsninger. Brugere kan frit tilpasse AI’en til deres specifikke behov og kunstneriske stilarter.

Som nævnt ovenfor gør Stable Diffusions alsidighed det velegnet til næsten alle brugere. Både udviklere, forskere, designere, digitale kunstnere, AI-hobbyister og endda studerende kan få betydelige fordele af dets funktioner.

Den nyeste Stable Diffusion 3.5-model har avancerede funktioner til at generere finere billeddetaljer. Genererede fotos har ofte præcis belysning og motiver. Desuden kan den bedre passe til den specifikke kunstneriske stil baseret på dine instruktioner.

For de fleste billedgenereringsmodeller kan områder som menneskehænder og ansigtstræk være særligt udfordrende. Med implementeringen af en 16-kanals VAE kan disse almindelige artefakter og ufuldkommenheder effektivt håndteres. Stabil diffusion er god til at gengive præcise lyseffekter.

Trods disse forbedringer har Stable Diffusion stadig sine svagheder. Modellen står fortsat over for visse udfordringer, især i fuldkropsgengivelser. Ligesom andre AI-billedgenereringsmodeller producerer Stable Diffusion ofte uventede resultater, især når der genereres komplette menneskefigurer. Den nuværende Stable Diffusion 3.5 fungerer godt med nærbilleder, portrætter og forskellige ikke-menneskelige motiver.

Effektiviteten af Stable Diffusion varierer afhængigt af den specifikke modelversion, der anvendes, hardware, outputindstillinger og prompter. Generelt kan du med en kraftfuld NVIDIA GPU nemt generere et standard 1024x1024-billede på 5-15 sekunder. Stable Diffusion er bedre end mange alternativer og giver brugerne mulighed for at træne og finjustere modeller på deres egne datasæt. Dette er især værdifuldt for professionelle brugere.

Sammenlignet med de tidligere modeller er den nuværende Stable Diffusion 3.5 meget nemmere at bruge. "Nemheden" afhænger dog i høj grad af dine tekniske færdigheder, erfaringsniveau og valgte brugerflade.

Der findes flere tilgange til forskellige tekniske komfortniveauer. Gå til den officielle Stability AI-hjemmeside, få en licens og indsend derefter en POST-anmodning som krævet.

Relativt set er opsætningsprocessen for Stable Diffusion blevet dramatisk forenklet takket være forskellige integrerede løsninger. Derudover har Stable Diffusion en webgrænseflade med et omfattende dashboard til bedre styring af genereringsprocessen. For en effektiv lokal implementering anbefales det også at verificere de foreslåede hardwarekrav. For begyndere anbefaler vi at bruge Stable Diffusion på Windows 10 eller 11.

De fleste aktive fællesskaber og platforme, såsom Reddit, Discord og fora, indsamler relaterede teknikker, kreationer og problemløsningsløsninger om Stable Diffusion. Dette fællesskabsdrevne supportøkosystem kan hurtigt dele nye modeller, funktioner, praktiske løsninger og andre værdifulde ressourcer.

| Funktion/Model | Stabil diffusion | Midjourney | Seedance | VEO 3 |

| Prissætning | Gratis open source-model (Community License). Omkostninger til hardware og cloud | Abonnement: Omkring $10 – $$1.152/måned | API: $0.09 – $1.50 pr. video | API: Gemini Developer API-priser |

| Hardwarekrav | Høj (kræver en kraftig GPU) | Lav (kører på Discord, ingen lokal hardware nødvendig) | Cloudbaseret (ingen brugerhardware kræves) | Cloudbaseret (ingen brugerhardware kræves) |

| Tilpasning | Omfattende (Open source, understøtter ControlNet, LoRA og træning af brugerdefinerede modeller) | Begrænset (gennem prompter og grundlæggende parametre) | Omfattende (gennem prompts og kreative kontroller) | Begrænset (primært i prompts) |

| Billed-/videokvalitet | Høj øvre grænse, afhænger af modeller og tuning | Høj standardkvalitet, stærk kunstnerisk stil | HD 1080p-videoer | 8 sekunders 720p til 1080p videoer |

| Tekstforståelse | Godt, bliv trænet og forbedret med brugerdefinerede modeller | Fremragende | Fremragende, forstår komplekse instruktioner | Fremragende, forstår komplekse fortællinger |

| Brugervenlighed | Stejlere læringskurve | Let | API-baseret, kræver integration | Nemt, kræver integration |

Stable Diffusion er et godt valg for specifikke brugergrupper, primært dem med tekniske færdigheder og tilpasningskrav. Det tilbyder funktioner, der retfærdiggør dens stejlere læringskurve og hardwarekrav. For begyndere tilbyder mange konkurrenter dog en meget nemmere opsætnings- og brugeroplevelse. Hvis du har kompatibel hardware og tilstrækkelig motivation til at lære, er Stable Diffusion et fleksibelt og kreativt værktøj til AI-billedgenerering.

Spørgsmål 1. Hvad koster Stable Diffusion?

Stability AI tilbyder en Community License til udviklere, forskere, små virksomheder og skabere, så de kan bruge Core Models (inklusive Stable Diffusion 3) gratis, medmindre din virksomhed har en årlig omsætning på over $1M USD, eller du bruger Stable Diffusion-modellerne til et kommercielt formål. Generelt er Core Models og Derivative Works gratis for dig at bruge. Du indtaster de nødvendige oplysninger og indsender derefter en anmodning om den gratis Community License. Læs denne artikel for at få flere gratis AI-billedgeneratorer!

Spørgsmål 2. Er der hardwarekrav til Stable Diffusion?

Når du vil køre Stable Diffusion på din computer, afhænger brugeroplevelsen i høj grad af hardwaren, især GPU, RAM og CPU. Du bør have et NVIDIA-grafikkort. NVIDIAs CUDA-teknologi er designet med avanceret accelerationsteknologi. Det kan være den mest kompatible løsning til at køre Stable Diffusion. AMD-grafikkort anbefales ofte ikke på grund af manglende optimering.

Spørgsmål 3. Er Stable Diffusion ideel for begyndere?

Det er blevet meget nemmere at komme i gang med Stable Diffusion takket være installationspakker med ét klik og cloud-tjenester. For begyndere involverer processen dog stadig en indlæringskurve, for slet ikke at tale om at mestre dens fulde potentiale. Uanset om du vælger den lokale installation eller dens cloud-tjeneste, kan du efter at have kørt Stable Diffusion interagere med den via en webgrænseflade. Webbrugergrænsefladen har en visuel grænseflade til tekst-til-billede og billede-til-billede-funktioner. Du kan bruge dem til at generere og ændre billeder. Derudover skal du ofte give detaljerede tekstbeskrivelser for at producere de ønskede billeder. Den endelige kvalitet af dit genererede billede afhænger i høj grad af de instruktioner, du giver.

Spørgsmål 4. Hvilke typer billeder kan Stable Diffusion fremstille?

Stable Diffusion kan generere billeder i et meget stort udvalg af typer. De fleste kunststile understøttes, herunder realistiske billeder, anime, oliemaleri, akvarel og andre. Outputtet bestemmes primært af den specifikke AI-model, der bruges, og de prompts, der angives.

Først skal du vælge en Checkpoint-model. Modellen bestemmer den grundlæggende stil for det genererede billede, f.eks. om det skal være realistisk eller tegneserieagtigt. Du kan søge efter og downloade relaterede modeller fra fællesskabsplatforme som Hugging Face. Finpuds derefter med mindre modeller.

Spørgsmål 5. Kan jeg bruge Stable Diffusion til kommercielle formål?

Ja, du kan bruge Stable Diffusion til kommercielle formål. Du skal dog kontrollere de specifikke vilkår for den Stable Diffusion-version, du bruger, på den officielle hjemmeside. Reglerne kan have ændret sig på tværs af forskellige modelversioner. Derudover bør du sikre dig, at din planlagte kommercielle brug ikke overtræder licensens forbudte aktiviteter. Vær desuden opmærksom på den potentielle mangel på ophavsretsbeskyttelse af de billeder, du genererer.

Konklusion

Denne anmeldelse af Stable Diffusion giver dig en detaljeret introduktion til Stability AI’s tekst-til-billede-genereringsmodel, især den nyeste Stable Diffusion 3.5-model. Du bør gennem denne anmeldelse have et klart overblik over dens kapaciteter, ydeevne, styrker og svagheder. Når du er færdig med dette indlæg, bør du præcist vide, hvad Stable Diffusion kan gøre for dig, og om den er din tid værd.

Fandt du dette nyttigt?

477 stemmer

Aiseesoft AI Photo Editor er et avanceret desktopprogram designet til at forbedre, opskalere og udskære billeder.