Destacado: chat con IA , juegos como Retro , cambiador de ubicación , Roblox desbloqueado

Destacado: chat con IA , juegos como Retro , cambiador de ubicación , Roblox desbloqueado

¿Estás cansado de las infinitas herramientas de imágenes de IA?

Stable Diffusion se presenta como una solución de “libertad” para la generación de imágenes con IA. Cuando buscas un modelo de texto a imagen potente que pueda generar imágenes de alta calidad condicionadas por tus descripciones de texto, es posible que accedas a él o recibas recomendaciones relacionadas.

Sin embargo, en un campo en rápida expansión con modelos similares y competidores como Midjourney, Seedance y Veo 3, usted puede preguntarse: ¿Stable Diffusion vale la pena o Stable Diffusion realmente ofrece resultados de nivel profesional?

Esta reseña de Stable Diffusion ofrece toda la información necesaria sobre este modelo de generación de imágenes con IA y responde precisamente a esa cuestión.

Tabla de contenidos

Stable Diffusion es un modelo flexible de deep learning de texto a imagen desarrollado por Stability AI. Se basa en tecnología de difusión (lanzada en 2022) que puede transformar descripciones textuales en representaciones visuales. El modelo utiliza un codificador de texto CLIP ViT-L/14 para generar imágenes de alta calidad en respuesta a los prompts.

En comparación con los modelos de difusión anteriores, la nueva versión Stable Diffusion 3.5 reduce significativamente los requisitos de memoria. Su diseño incorpora una gran innovación arquitectónica al implementar el proceso de difusión en un espacio latente. Los modelos anteriores operan directamente en el espacio de la imagen.

Gracias al avance técnico y su naturaleza de código abierto, Stable Diffusion pronto atrajo a una base de usuarios mucho más amplia, incluidos desarrolladores, investigadores, creadores individuales y usuarios empresariales.

• Mejora constante con las actualizaciones de versión. Desde su lanzamiento inicial, este modelo de generación de texto a imagen ha experimentado una evolución significativa. Las versiones principales incluyen Stable Diffusion 1.5, 2.0, 2.1, 3.0 y la última serie 3.5. Han realizado mejoras sustanciales en varios aspectos, como la calidad de salida, la comprensión de los prompts y las capacidades de generación, entre otros.

• Múltiples versiones del modelo. Se han diseñado varios modelos especializados para abordar diferentes necesidades de los usuarios. El modelo base más reciente es Stable Diffusion 3.5. Ofrece mejoras significativas respecto a versiones anteriores. Actualmente hay cuatro versiones principales en la familia Stable Diffusion: Stable Diffusion 3.5 Large, Large Turbo, Medium y Flash.

• Comprensión avanzada de prompts. El actual Stable Diffusion 3.5 incorpora una sofisticada arquitectura de multiencodificador de texto que le permite procesar prompts más complejos y detallados de forma más eficaz. Puede procesar descripciones de texto de hasta 10.000 caracteres. Esto permite a los usuarios ofrecer descripciones más detalladas. Al mismo tiempo, Stable Diffusion puede producir resultados de mayor calidad y más precisos.

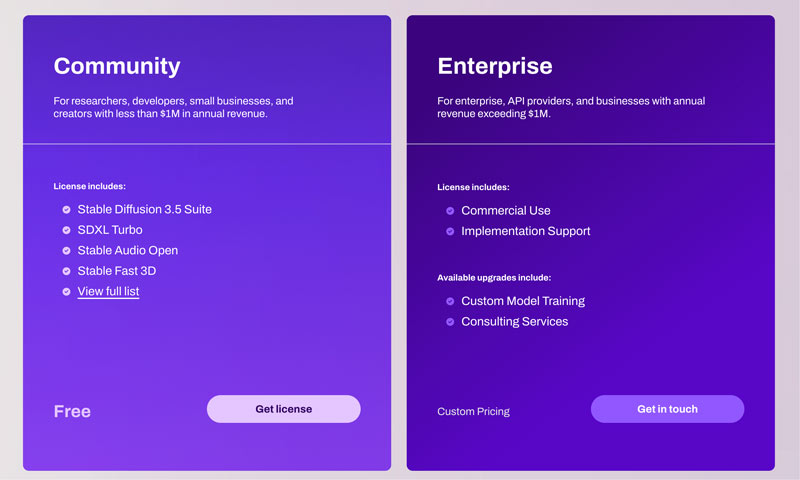

• Flexibilidad comercial y creativa. Los modelos Stable Diffusion 3.5 se publican bajo la Stability AI Community License y la Enterprise License, lo que permite tanto el uso comercial como el no comercial. Para la mayoría de los usuarios ocasionales, como investigadores, desarrolladores y pequeñas empresas con ingresos anuales inferiores a $1M, Stable Diffusion se puede utilizar libremente y sin restricciones. Los usuarios pueden adaptar la IA libremente a sus necesidades específicas y estilos artísticos.

Como se mencionó anteriormente, la versatilidad de Stable Diffusion lo hace adecuado para casi todos los usuarios. Desarrolladores, investigadores, diseñadores, artistas digitales, aficionados a la IA e incluso estudiantes pueden beneficiarse significativamente de sus capacidades.

El último modelo de Stable Diffusion 3.5 cuenta con funciones avanzadas para generar imágenes con detalles más precisos. Las fotos generadas suelen tener una iluminación y sujetos precisos. Además, se adapta mejor al estilo artístico específico según tus indicaciones.

Para la mayoría de los modelos de generación de imágenes, áreas como las manos y los rasgos faciales pueden ser particularmente complejas. Con la adopción de un VAE de 16 canales, estos artefactos e imperfecciones comunes se pueden abordar eficazmente. La Difusión Estable es eficaz para generar efectos de iluminación precisos.

A pesar de estas mejoras, Stable Diffusion aún presenta debilidades. El modelo sigue enfrentando ciertos desafíos, especialmente en renderizados de cuerpo completo. Al igual que otros modelos de generación de imágenes con IA, Stable Diffusion suele producir resultados inesperados, sobre todo al generar figuras humanas completas. La versión actual de Stable Diffusion 3.5 funciona bien con primeros planos, retratos y diversos sujetos no humanos.

La eficiencia de Stable Diffusion varía según la versión del modelo, el hardware, la configuración de salida y las indicaciones. Generalmente, con una GPU NVIDIA potente, se puede generar fácilmente una imagen estándar de 1024x1024 en 5-15 segundos. Mejor que muchas alternativas, Stable Diffusion permite a los usuarios entrenar y ajustar los modelos con sus propios conjuntos de datos. Esto es especialmente útil para usuarios profesionales.

En comparación con los modelos anteriores, el actual Stable Diffusion 3.5 es mucho más fácil de usar. Sin embargo, la facilidad de uso depende en gran medida de tus habilidades técnicas, tu nivel de experiencia y la interfaz elegida.

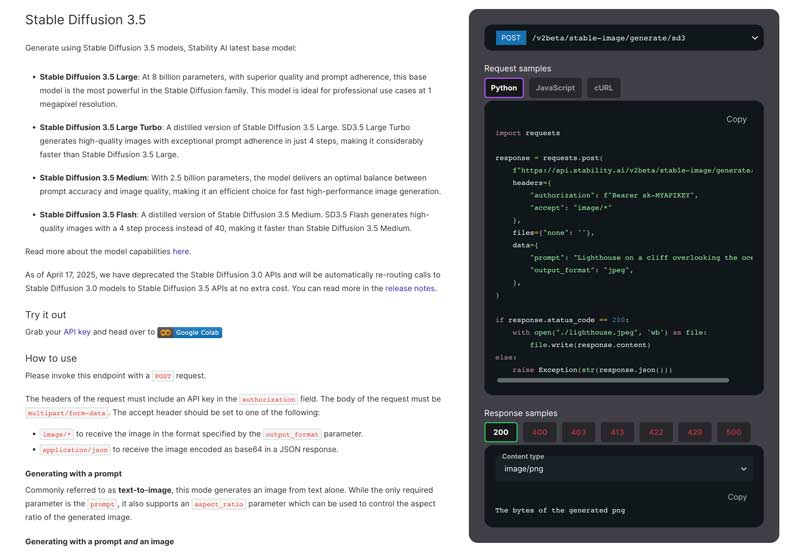

Hay varios enfoques disponibles para distintos niveles de familiaridad técnica. Ve al sitio web oficial de Stability AI, obtén una licencia y luego envía una solicitud POST según se requiera.

En términos relativos, gracias a diversas soluciones integradas, el proceso de configuración de Stable Diffusion se ha simplificado enormemente. Además, Stable Diffusion cuenta con una interfaz web que incluye un panel completo para un mejor control del proceso de generación. Para una implementación local eficaz, también se recomienda verificar los requisitos de hardware sugeridos. Para principiantes, recomendamos usar Stable Diffusion en Windows 10 u 11.

La mayoría de las comunidades y plataformas activas, como Reddit, Discord y foros, recopilan técnicas, creaciones y soluciones relacionadas con la difusión estable. Este ecosistema de soporte comunitario puede compartir rápidamente nuevos modelos, funciones, soluciones prácticas y otros recursos valiosos.

| Característica/modelo | Difusión estable | A mitad del viaje | Danza de semillas | VEO 3 |

| Precios | Modelo gratuito de código abierto (licencia comunitaria). Costos de hardware y nube. | Suscripción: Alrededor de $10 – $$1,152/mes | API: $0.09 – $1.50 por vídeo | API: Precios de la API para desarrolladores de Gemini |

| Requisitos de hardware | Alto (requiere una GPU potente) | Bajo (se ejecuta en Discord, no necesita hardware local) | Basado en la nube (no requiere hardware de usuario) | Basado en la nube (no requiere hardware de usuario) |

| Personalización | Extenso (código abierto, compatible con ControlNet, LoRA y entrenamiento de modelos personalizados) | Limitado (A través de indicaciones y parámetros básicos) | Extenso (a través de indicaciones y controles creativos) | Limitado (principalmente en indicaciones) |

| Calidad de imagen/vídeo | Límite superior alto, depende de los modelos y la configuración. | Alta calidad predeterminada, fuerte estilo artístico. | Vídeos de alta definición de 1080p | Vídeos de 8 segundos de 720p a 1080p |

| Comprensión de textos | Bueno, capacitarse y mejorarse con modelos personalizados | Excelente | Excelente, entiende indicaciones complejas. | Excelente, entiende narrativas complejas. |

| Facilidad de uso | Curva de aprendizaje más pronunciada | Fácil | Basado en API, requiere integración | Fácil, necesita integración. |

Stable Diffusion es una buena opción para grupos de usuarios específicos, principalmente aquellos con habilidades técnicas y requisitos de personalización. Ofrece capacidades que justifican su mayor curva de aprendizaje y los requisitos de hardware. Sin embargo, para principiantes, muchos competidores ofrecen una configuración y una experiencia de uso mucho más sencillas. Si cuenta con hardware compatible y suficiente motivación para aprender, Stable Diffusion es una herramienta flexible y creativa para la generación de imágenes con IA.

Pregunta 1. ¿Cuánto cuesta Stable Diffusion?

Stability AI ofrece una Community License para que desarrolladores, investigadores, pequeñas empresas y creadores utilicen los Core Models (incluido Stable Diffusion 3) de forma gratuita, a menos que tu negocio genere más de $1M USD de ingresos anuales o estés utilizando los modelos de Stable Diffusion con fines comerciales. En general, los Core Models y las Derivative Works son gratuitos para tu uso. Introduces la información requerida y luego envías una solicitud para la Community License gratuita. ¡Lee este artículo para descubrir más generadores de imágenes con IA gratuitos!

Pregunta 2. ¿Hay requisitos de hardware para Stable Diffusion?

Al ejecutar Stable Diffusion en tu ordenador, la experiencia de usuario depende en gran medida del hardware, especialmente de la GPU, la RAM y la CPU. Te recomendamos una tarjeta gráfica NVIDIA. La tecnología CUDA de NVIDIA está diseñada con tecnología de aceleración avanzada. Puede ser la opción más compatible para ejecutar Stable Diffusion. Las tarjetas gráficas AMD no suelen recomendarse por falta de optimización.

Pregunta 3. ¿Es Stable Diffusion ideal para principiantes?

Comenzar a usar Stable Diffusion es mucho más fácil gracias a los paquetes de instalación con un solo clic y los servicios en la nube. Sin embargo, para los principiantes, el proceso aún implica una curva de aprendizaje, por no hablar de dominar todo su potencial. Tanto si elige la instalación local como su servicio en la nube, después de ejecutar Stable Diffusion, puede interactuar con él a través de una interfaz web. La interfaz web de usuario (UI) cuenta con una interfaz visual para las funciones de texto a imagen y de imagen a imagen. Puede usarlas para generar y modificar imágenes. Además, a menudo necesitará proporcionar descripciones de texto detalladas para producir las imágenes deseadas. La calidad final de la imagen generada depende en gran medida de las indicaciones que proporcione.

Pregunta 4. ¿Qué tipos de imágenes puede producir Stable Diffusion?

Stable Diffusion puede generar imágenes en una enorme variedad de tipos. Se admiten la mayoría de estilos artísticos, como imágenes realistas, anime, óleo, acuarela y otros. Los resultados dependen principalmente del modelo de IA específico utilizado y de los prompts proporcionados.

Primero, necesitas elegir un modelo Checkpoint. El modelo determina el estilo principal de la imagen generada, por ejemplo, si será realista o tipo dibujo animado. Puedes buscar y descargar modelos relacionados desde plataformas comunitarias como Hugging Face. Después, perfecciónalo con modelos más pequeños.

Pregunta 5. ¿Puedo usar Stable Diffusion con fines comerciales?

Sí, puedes usar Stable Diffusion con fines comerciales. Sin embargo, verifica los términos específicos de la versión de Stable Diffusion que estés usando en el sitio web oficial. Las reglas pueden haber cambiado según las diferentes versiones del modelo. Además, asegúrate de que el uso comercial que planees no infrinja las actividades prohibidas de la licencia. Además, ten en cuenta la posible falta de protección de derechos de autor para las imágenes que generes.

Conclusión

Esta reseña de Stable Diffusion te ofrece una introducción detallada al modelo de generación de texto a imagen de Stability AI, especialmente al último modelo Stable Diffusion 3.5. Deberías tener una visión clara de sus capacidades, rendimiento, puntos fuertes y limitaciones gracias a la reseña. Al final de este artículo, deberías saber exactamente qué puede hacer Stable Diffusion por ti y si merece la pena dedicarle tu tiempo.

encuentras esto de ayuda?

477 votos

Aiseesoft AI Photo Editor es una aplicación de escritorio avanzada diseñada para mejorar, ampliar y recortar imágenes.