Valokeilassa: tekoälychat , pelit kuten Retro , sijainninvaihtaja , Robloxin esto poistettu

Valokeilassa: tekoälychat , pelit kuten Retro , sijainninvaihtaja , Robloxin esto poistettu

Llama 1:n uraauurtavan julkaisun jälkeen suljetut, suljetut API:t demokratisoitiin peruuttamattomasti. Metan avoimen lähdekoodin Llama (Large Language Model Meta AI) -sarja on mullistanut tekoälymaisemaa. Erittäin tehokas Llama 3 ja sen uusin versio Llama 4 tekevät tästä mallistosta avoimen lähdekoodin tekoälyinnovaation perustan.

Jos olet hämmentynyt lukemattomista tekoälymalleista, lue tämä kattava Llama-arvostelu. Saat tietää, mitä Llama on, mikä tekee Llama AI:sta ainutlaatuisen, sen vahvasta liiketoimintaperustasta, sen kilpailuasemasta jättiläisiä kuten ChatGPT vastaan, käytännöllisestä oppaasta yrityksille ja paljon muusta.

Sisällysluettelo

Llama tarkoittaa kokoelmaa Metan kehittämiä perustavanlaatuisia suuria kielimalleja. Toisin kuin aiemmat mallit, joihin pääsi käsiksi vain API:n kautta, Llama-sarja on julkaistu julkisesti tutkimus- ja kaupalliseen käyttöön. Mukautettu lisenssi on toki suunniteltu väärinkäytön estämiseksi, ja se pätee tietyissä skaalausolosuhteissa. Uusin versio on Llama 4.

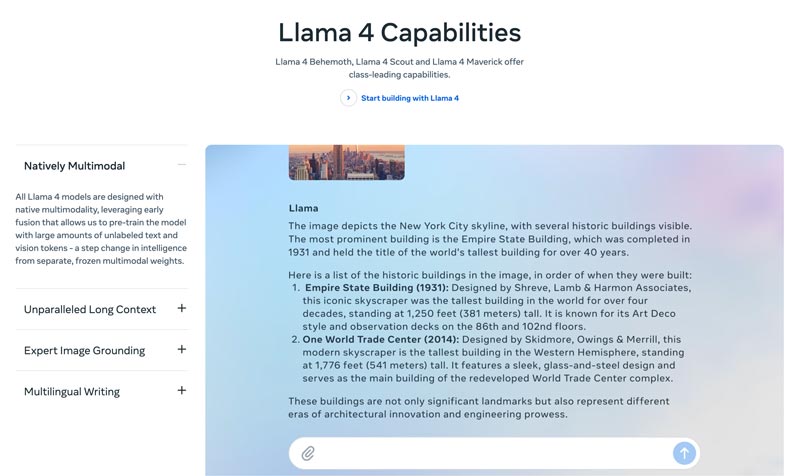

Llama 4 on uusin versio. Meta väittää, että se on älykkäin, parhaiten skaalautuva ja kätevin versio. Kehittyneempien päättely- ja suunnittelukykyjen, multimodaalisten ominaisuuksien ja monikielisten kirjoitustoimintojen ansiosta Llama 4 voi tarjota alan johtavan konteksti-ikkunan. Sen avulla voit helposti ottaa käyttöön uskomattomimmat ideasi Llama API:n ja Llama Stackin avulla. Nykyinen Llama 4 mahdollistaa entistä henkilökohtaisemmat kokemukset.

Llama 3 julkaistiin huhtikuussa 2024. Verrattuna Llama 2:een Llama 3 tuo mukanaan useita parannuksia, kuten paremman päättely- ja koodauskyvyn, parannetun opetusdatan, suuremman konteksti-ikkunan ja tehokkaamman tokenisoijan.

Llama 1 & 2: Alkuperäinen Llama julkaistiin vuoden 2023 alussa ja Llama 2 heinäkuussa 2023. Ne merkitsivät Metan suoraa tuloa chatbot-markkinoille. Hienosäädetyn version myötä sarja on Llama 2:sta lähtien tarjonnut hyödyllistä ja turvallista dialogia. Llama 1/2 kehitettiin pääasiassa haastamaan suoraan OpenAI:n ChatGPT ja Googlen Bard.

Meta on kehittänyt Llaman uudistaakseen tekoälymaisemaa, joten korkea suorituskyky ei ole huolesi. Llamaa hienosäädetään yrityksesi omalla datalla, jotta se päihittäisi suuremmat yleismallit tietyissä tehtävissä. Tämä hienosäätöpotentiaali tekee siitä sopivan suurimmalle osalle kehittäjistä ja tutkijoista.

Llaman ainutlaatuisuus ei rajoitu suorituskykyyn. Llaman synnyttämä ekosysteemi voi olla vielä suurempi etu. Sen Hugging Face -ekosysteemi on synnyttänyt valtavan innovaatioryöpyn. Tuhansia hienosäädettyjä johdannaismalleja on tarjolla erilaisiin kuviteltavissa oleviin tehtäviin.

Lisäksi Llama on tuonut huipputasoisen kielimallin kaikkien ulottuville. Tekoälyn demokratisoituminen on toinen etu, joka tekee Llamasta erityisen. Llama AI -malleja voivat käyttää kaikki tutkijat, kehittäjät ja startupit innovointiin ja rakentamiseen ilman API-maksuja tai lupapyyntöjä.

Strateginen etu yrityksille. Llama antaa sinun omistaa oman tekoälyrakentamisesi. Sinun ei enää tarvitse olla sidottu tietyn toimittajan hinnoitteluun, käytäntömuutoksiin tai API:n poistamisiin. Se ehkäisee toimittajalukon tehokkaasti.

Llaman liiketoimintatapaus ei koske pelkästään erilaisen tekoälymallin käyttöä. Itse asiassa se voi olla perustavanlaatuinen muutos yrityksen tavassa suhtautua tekoälyyn.

Alkuvaiheessa monet yritykset ottivat käyttöön API-pohjaisia palveluja, kuten OpenAI:n GPT-4:n. Se voi olla kaikista kätevin vaihtoehto, sillä se mahdollistaa matalan kynnyksen kokeilun ja nopean prototypoinnin. Tätä tekoälystrategiaa on kuitenkin alettu korvata strategisemmalla, pitkäjänteisemmällä lähestymistavalla: avoimen lähdekoodin perustamalleilla, kuten Metan Llamalla. Llaman liiketoimintaperusta rakentuu kolmeen keskeiseen tekijään: kustannussäästöihin, hallintaan ja räätälöitävyyteen sekä tietoturvaan.

Monien yritysten API-kustannukset (miljoonien kyselyiden käsittely päivässä) voivat olla miljoonia vuodessa. Llaman käyttöönotto tarkoittaa siirtymistä operatiivisista kuluista (OpEx) pääomakuluihin (CapEx). Tämä tekee sijoitetun pääoman tuottoprosentin selväksi suurilla volyymeilla.

Llaman avulla voit luoda ainutlaatuisen hienosäädetyn tekoälyn, joka sopii parhaiten yrityksellesi tai tuotteillesi. Sinulla on myös täysi hallinta mallisi syötteistä ja tuotoksista. Siitä tulee ydinomaisuus, ei vuokrattu palvelu.

Valtionhallinnolla ja rahoitusalalla on tiukat tiedonhallintavaatimukset. Llama voidaan ottaa käyttöön kokonaan paikallisesti tai yhteensopivassa VPC:ssä (Virtual Private Cloud). Se on usein ainoa laillinen tapa hyödyntää LLM-teknologiaa. Lisäksi Llaman käyttöönotto suojatussa VPC:ssä tarkoittaa, että kaikki tietosi ovat suojattuja eivätkä koskaan poistu palomuuriltasi. Tämä poistaa tehokkaasti kolmannen osapuolen tietojen paljastumisen riskin.

Yhteenvedonomaisesti Llaman liiketoimintaperusta liittyy omistajuuteen. Saat takaisin kilpailuetusi, tietojesi turvallisuuden ja kustannustesi hallinnan.

Metan Llama tarjoaa yrityksille uuden tavan hyödyntää tekoälyä. Tällä tehokkaalla tekoälymallilla on laaja käyttöalue, mukaan lukien keskusteleva tekoäly, kuvien ja tekstin generointi, kieliharjoittelu, tiivistäminen ja muut vastaavat tehtävät. Hyödyntämällä edistyneitä tekoälyominaisuuksia Llama voi auttaa yrityksiä menestymään.

• Asiakaspalvelu ja -tuki

Llaman avulla toimivat edistyneet chatbotit tai virtuaaliassistentit pystyvät ymmärtämään asiakkaiden kysymyksiä, erityisesti monimutkaisia kyselyitä, paremmin ja tarjoamaan oikeita, kontekstitietoisia vastauksia. On hyödyllistä tarjota 24/7-asiakastukea.

• Data-analyysi ja liiketoimintatiedon hallinta

Llama voi hakea dataa useista lähteistä ja tehdä päätöksiä, jotka aluksi vaativat teknistä osaamista. Sen avulla yritysjohtajat ja analyytikot voivat saada SQL-kyselyn esittämällä kysymyksiä. Malli voi analysoida tekstiä, kuvia, kaavioita ja muuta sisältöä antaakseen narratiivisen yhteenvedon. Tämä auttaa tunnistamaan nopeasti nousevia trendejä, kilpailutietoja ja yleisiä valituksia.

• Markkinointi ja sisällön automaatio

Korkealaatuisen ja hakukoneoptimoidun sisällön tuottaminen on aikaa vievää. Llama voi nopeasti luoda luonnoksia tai kokonaisia artikkeleita yksinkertaisella aiheella ja useilla avainsanoilla. Ihmiseditorit voivat sitten tarkentaa näitä tuloksia. Malli voi myös automatisoida sosiaalisen median julkaisujen luomisen. Lisäksi se voi auttaa kirjoittamaan houkuttelevia otsikkorivejä sähköposteihin ja mainoksiin.

• Ohjelmistokehitys

Koodikohtainen Llama-malli voi toimia edistyneenä automaattisena täydennyksenä koodin laadun ylläpitämiseksi, vanhojen järjestelmien hallitsemiseksi ja kehityssyklien nopeuttamiseksi. Se voi auttaa koodin tarkistamisessa mahdollisten virheiden varalta. Lisäksi se voi automaattisesti luoda ja päivittää koodidokumentaatiota ja API-viittauksia lähdekoodikommenttien perusteella.

Tässä osiossa vertaillaan Metan Llama-sarjaa ja muita johtavia vaihtoehtoja taulukkomuodossa. Voit vertailla näitä keskeisiä tekijöitä löytääksesi parhaiten tarpeisiisi sopivan tuotteen.

On selvää, että näillä tekoälymalleilla on omat vahvuutensa ja heikkoutensa. Valinta ei ole vain yhden vaihtoehdon löytämistä.

| AI mallit | Metan LLaMA 4/3/2 | OpenAI:n GPT-4 | Antrooppisen Claude 3 | Googlen PaLM 2 |

| Lisenssi | Avoimen lähdekoodin, mukautettu lisenssi | Omistusoikeudellinen | Omistusoikeudellinen | Omistusoikeudellinen |

| Pääsy | Lataa ja itse isännöi | Vain API Käyttö tilauksen kautta | Vain API Käyttöperusteisen hinnoittelun kautta | Vain API Käyttö Googlen Vertex-tekoälyn kautta |

| AI mallit | Metan LLaMA 4/3/2 | OpenAI:n GPT-4 | Antrooppisen Claude 3 | Googlen PaLM 2 |

| Esitys | Huipputaso Kilpailukykyinen huipputekoälymallien kanssa Vaatii hienosäätöä GPT-4:n suorituskyvyn vastaamiseksi tietyissä tehtävissä Heikko kiinnostavan ja korkealaatuisen luovan sisällön tuottamisessa | Alan johtava Käsittele monimutkaista päättelyä, vivahteita ja luovaa ongelmanratkaisua | Huipputaso Erinomainen data-analyysissä, hienostuneessa vuoropuhelussa ja pitkän kontekstin päättelyssä | Huipputaso Erinomainen päättelykyvyssä ja monikielisissä tehtävissä |

| Kustannusrakenne | Korkeat investointikulut, matalat käyttökulut Kustannusasteikot mallin koon ja käyttömäärän mukaan | Ei investointikuluja, korkeita käyttökuluja alkukustannukset, mutta käytöstä maksetaan token-kohtaista maksua | Ei investointeja, korkeat käyttökustannukset Samanlainen kuin OpenAI, maksu token-kohtaisesti | Ei investointeja, korkeat käyttökustannukset Maksa token-kohtaisesti Vertex AI:ssa, volyymialennuksilla |

| Tietosuoja ja -turvallisuus | Maksimaalinen hallinta Data ei koskaan poistu infrastruktuuristasi Ihanteellinen erittäin säännellyille toimialoille | Tulo-/lähtödataa käsitellään OpenAI:n palvelimilla | Vahva tietosuojakäytäntö, mutta tietoja käsittelee Anthropic | Yritystason tietoturva Google Cloudissa käsiteltävät tiedot Tarjoaa VPC-suojausta ja tietojen säilytyssitoumuksia |

| Mukauttaminen ja hallinta | Täydellinen hallinta Voidaan hienosäätää täysin omien tietojen perusteella | Rajoitettu Hienosäätö on käytettävissä vain vanhemmissa malleissa (ei GPT-4) | Rajoitettu Räätälöity nopean suunnittelun ja kontekstin avulla | Vahva Hyvä tuki hienosäätöön ja vahvistusoppimiseen |

| Skaalautuvuus | Sinun on hankittava ja hallittava omaa infrastruktuuriasi | OpenAI hallinnoi kaikkea infrastruktuuria | Anthropic hallinnoi kaikkea infrastruktuuria | Google Cloud hallinnoi infrastruktuuria |

Yleisesti ottaen Llama on ihanteellinen yrityksille, jotka haluavat täyden hallinnan, tietosuojan ja mukautettavuuden. GPT-4 sopii parhaiten yrityksille, jotka vaativat parasta mahdollista suorituskykyä ja päättelykykyä. Se pystyy käsittelemään monimutkaisia tehtäviä paremmin, erityisesti luovaa ja edistynyttä analyysiä. Claude 3 sopii erinomaisesti sovelluksiin, joissa turvallisuus ja harhan vähentäminen ovat ensiarvoisen tärkeitä. Se tuottaa harvoin haitallisia tuloksia. PaLM 2 sopii parhaiten yrityksille, jotka ovat syvästi integroituneet Google Cloud -ekosysteemiin. Se varmistaa saumattoman integroinnin muiden Google-työkalujen kanssa.

Ennen Llaman käyttöönottoa sinun tulisi ensin selvittää tarpeesi tietyn käyttötapauksen mukaan. Tarvitsetko 70B-parametrimallin parhaan mahdollisen laadun saavuttamiseksi vai vain 8B-mallin perustehtäviin?

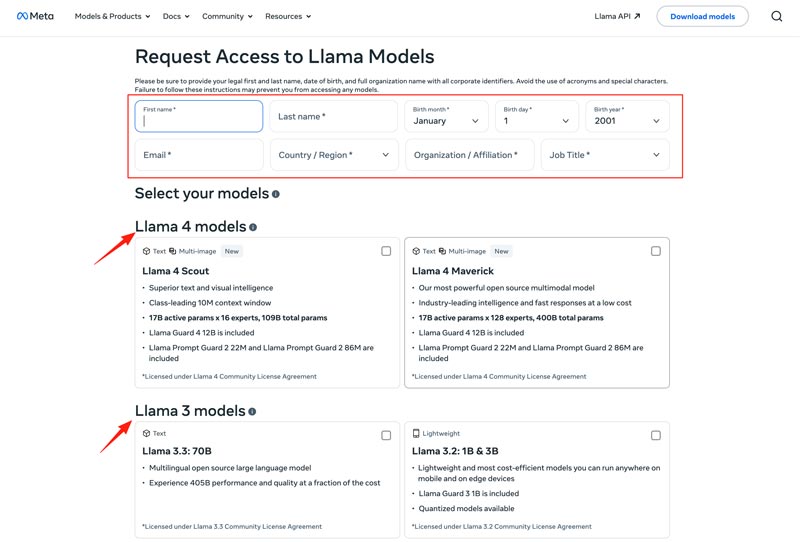

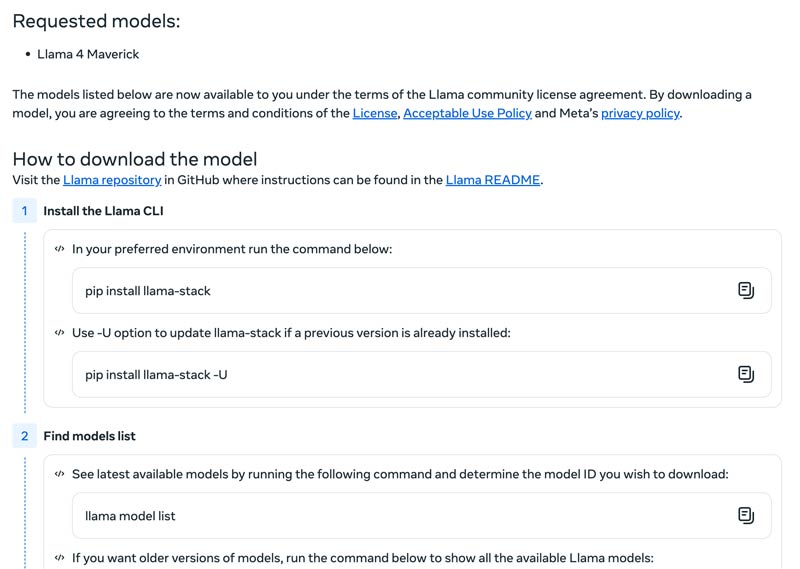

Sinun tulisi valita käyttöönottotapasi, kuten paikallinen kone, pilvivirtuaalikone tai hallittu palvelu. Llama-mallien tehokas suorittaminen vaatii usein tehokkaan näytönohjaimen, erityisesti suuremmissa malleissa. Sen jälkeen voit ladata oikean mallin Meta-verkkosivustolta.

Napsauta Lataa mallit -painiketta päästäksesi Pyydä käyttöoikeutta -sivulle. Anna vaaditut tiedot ja valitse haluamasi Llama-malli.

Napsauta Seuraava-painiketta lukeaksesi Käyttöehdot. Sinun tulisi tarkistaa Community License Agreement huolellisesti ja napsauttaa sitten Hyväksy ja jatka -painiketta. Seuraa näytön ohjeita ladataksesi valitsemasi mallin.

Voit käyttää esimerkiksi Text Generation Inference -kehystä saadaksesi suorituskykyisen API-palvelimen. Jos tarvitset keskustelukäyttöliittymän, ota käyttöön UI, kuten Chatbot UI tai NextChat. Tämän jälkeen käytä omaa dataasi yhdessä kehysten kanssa luodaksesi oman erikoistuneen mallisi.

Sinun tulisi tietää, miten voit voittaa haasteet käyttääksesi tekoälymalleja tehokkaasti.

• Alkuasennuksen monimutkaisuus

Voit käyttää sen valmiita työkaluja ja säilöjä. Suorita malleja paikallisesti yhdellä komennolla. Voit myös siirtyä pilvipohjaisiin alustoihin ilman paikallisia asetuksia. Hugging Facen avulla voit suorittaa ja luoda demoja valmiiksi määritettyjen ympäristöjen avulla. Lisäksi voit aloittaa llama.cpp:llä suorittaaksesi kvantisoidun version Llamasta.

• Resurssien hallinta ja kustannusten optimointi

Suuret mallit vaativat paljon muistia sisältäviä näytönohjaimia, jotka ovat usein niukkoja ja kalliita.

Kvantisointi on tehokkain tekniikka. Voit käyttää kirjastoja 4-bittiseen kvantisointiin päättelyn tai hienosäädön aikana. Vähemmän tehokkaalla laitteistolla käytä llama.cpp-tiedostoa mallien suorittamiseen. Molemmat menetelmät voivat tehokkaasti vähentää muistin käyttöä. Varmista lisäksi, että valitset tehtäviisi sopivan mallin. Pienempi, hienosäädetty malli voi olla kustannustehokkaampi.

• Uusien julkaisujen mukana pysyminen

Monet uudet mallit, tekniikat ja kirjastot julkaistaan viikoittain. Ajan tasalla pysyminen voi olla vaikeaa.

Sinun kannattaa tilata viralliset blogit, kuten Meta AI, Hugging Face ja vLLM. Lisäksi uusia hienosäätötekniikoita, sovelluksia, tehokkuuden parannuksia, kokemuksia, ratkaisuja ja paljon muuta jaetaan alustoilla, kuten GitHub ja Hugging Face. Tämä antaa tiimillesi mahdollisuuden integroida parannuksia.

Tarvitset ehkä myös:

Kysymys 1. Onko sallittua käyttää Llama-mallien tuottamia ulostuloja muiden kielimallien kouluttamiseen?

Kyllä, Meta sallii Llaman tuotoksen uudempien versioiden (Llama 3.1 ja uudemmat) käytön muiden mallien kouluttamiseen. Et tietenkään saa käyttää sitä Metan kanssa kilpailevan tuotteen luomiseen. Lisäksi sinun on oltava hyvin tietoinen Metan lisenssin asettamista laillisista rajoista.

Kysymys 2. Onko Llama-malleilla rajoituksia? Mitkä ovat asiaan liittyvät ehdot?

Kyllä, Llama-malleilla on merkittäviä rajoituksia, jotka on määritelty niiden lisenssirakenteessa. Nämä mallit eivät ole aidosti avoimen lähdekoodin. Sen sijaan ne julkaistaan Metan omalla lisenssillä. Tämä on tehty Metan etujen suojelemiseksi ja kilpailevien käyttötapausten estämiseksi.

Kysymys 3. Mitkä ovat Llaman yleisimmät käyttötapaukset?

Llaman jokapäiväisiä käyttötarkoituksia ovat kuvien ja dokumenttien ymmärtäminen, kysymyksiin vastaaminen, kuvien ja tekstien luominen, kielen luominen ja yhteenveto, kielikoulutus, keskustelun tekoäly ja paljon muuta. Llama voi vastata kysymykseesi antamasi kuvan tai dokumentin sisällön perusteella. Lisäksi sitä voidaan käyttää chatbotin tai visuaalisen avustajan luomiseen.

Kysymys 4. Mitkä ovat Llama-mallien laitteistovaatimukset?

Llama-mallien suorittamiseen tarvittavat laitteistovaatimukset määräytyvät kolmen keskeisen tekijän perusteella: mallin koko, kvantisointi ja käyttötapaus. Useimmille kehittäjille RTX 4070/4080/4090 tai Mac, jossa on 16–36 Gt:n Unified Memory -muistia, on joustava valinta Llama-malleille aina 70 B:hen asti. GPU-pohjaisessa toiminnassa tärkein tekijä on näytönohjaimen VRAM-muisti. Kuten mainittiin, valitse oikea mallin koko tarpeidesi mukaan ja valitse sitten kvantisointitaso, jota laitteistosi pystyy suorittamaan.

Kysymys 5. Onko Llama yhtä hyvä kuin ChatGPT?

Voit tarkastella yllä olevaa taulukkoa vertaillaksesi Llaman ja ChatGPT:n keskeisiä tekijöitä. Llamaa voidaan ajaa paikallisesti ja offline-tilassa. Se tarjoaa turvallisemman tietosuojan. Lisäksi Llama-malli itsessään on ilmainen käyttää. ChatGPT:stä on ilmainen versio, mutta sen kehittyneet mallit ja ominaisuudet vaativat maksullisen tilauksen.

Johtopäätös

Llama ei ole vain yksi malli muiden joukossa. Sitä pidetään usein strategisena siirtymänä kohti helpommin saavutettavaa ja räätälöitävämpää tekoälytulevaisuutta. Tästä suoraviivaisesta arvostelusta voit oppia monenlaista Llama AI -perheeseen liittyvää tietoa ja selvittää, onko se kaiken hypen arvoinen.

Oliko tästä apua?

484 ääntä